Foto’s automatisch laten indexeren en beoordelen met kunstmatige intelligentie

Fotograferen is leuk, maar het uitzoeken en ordenen van bergen foto’s een stuk minder. Bij de meesten bungelt het organiseren van fotoverzamelingen onderaan een ToDo-lijstje, om daar nooit meer vanaf te komen. Wie dit bekend voorkomt, kan nu opgelucht ademhalen. Want machinaal getrainde zoekmachines kunnen nu duizenden objecten en onderwerpen herkennen. Hierdoor kunnen programma’s automatisch trefwoorden aan foto’s toewijzen en je helpen bij het selecteren van de beste opnames.

Lees verder na de advertentie

Als je als fotograaf na een fotoshoot ’s thuiskomt van een fotoshoot, begint vaak het echte werk pas. Want nu moet de overweldigende hoeveelheid opnames gereduceerd worden tot de beste tien procent. Die moet je vervolgens van de juiste trefwoorden voorzien en stuk-voor-stuk bewerken. Veel fotografen ontwikkelen daarvoor een bepaalde routine en een goed oog om er de beste foto’s snel uit te filteren. Maar dat betekent nog niet dat ze er veel plezier beleven. Het gevolg is dat fotoarchieven vaak een zootje zijn. Wat zou het fijn zijn als je een beroep kon doen op een alwetende sorteerassistent uit een AI-lab. Een persoonlijke assistent die goede foto’s van mislukte kan onderscheiden. Eentje die zelfs na een lange werkdag nog onvermoeibaar geschikte trefwoorden kan verzinnen voor duizenden foto’s.

- AI en cognitieve vaardigheden

- Werken met gestructureerde processen

- Gaat AI werknemers vervangen?

- c’t security-checklist 2026

Nieuwe impuls

Tip!

Slimme IP-camera’s met live toezicht en haarscherpe beveiliging!

Het ziet er naar uit dat zoiets nu ook echt binnen handbereik ligt. Met een eigen neuraal netwerk (deep learning) ontketende Google vier jaar geleden een ware revolutie in fotoherkenning. Sindsdien verschijnen er doorlopend nieuwe systemen voor automatische beeldanalyse. Dit plotselinge succes gaf het bijna in vergetelheid geraakte AI-onderzoek een nieuwe impuls. Sindsdien werken ontwikkelaars aan steeds geraffineerdere architecturen met steeds meer lagen. De nieuwste systemen herkennen niet alleen de belangrijkste objecten in een foto, maar maken op basis daarvan ook beschrijvingen en proberen de sfeer te peilen. Ze beoordelen zelfs de kwaliteit en de schoonheid van de foto’s.

De artistieke scene wordt al tientallen jaren gedomineerd door Adobe. Hoewel het tot de A.I. pioniers behoort, heeft het bedrijf zich wel volledig op deze nieuwe ontwikkelingen gestort. Met Sensei introduceerde de softwarefabrikant op de eigen beurs Adobe MAX een speciaal framework dat machine learning combineert voor Creative Cloud, marketing en documentenverwerking. En met de Marketing Cloud heeft het bedrijf de laatste jaren een perfecte derde pijler gebouwd: web analytics.

In the picture

Om de stand van zaken op te maken, hebben we de interessantste systemen voor professionals en amateurfotografen onder de loep genomen. Google Foto’s van de gelijknamige AI-pionier wordt ondersteund door browsers, apps en de cloud. De service optimaliseert foto’s afhankelijk van het onderwerp en geeft er trefwoorden aan mee. Apple Foto’s voor iOS en macOS en het fotobewerkingsprogramma Photoshop Elements combineren object- en gezichtsherkenning. Excire voorziet gebruikers van Lightroom van een intelligente zoekfunctie voor trefwoorden en overeenkomsten. Voor het consequent sorteren van foto’s zijn Picturio en EyeEM Vision handig. Beide kunnen de visuele en technische kwaliteit van foto’s beoordelen en kunnen fotografen helpen om hun beste shots uit te zoeken.

Slimme hulpjes op de achtergrond

Zo fascinerend en ingewikkeld als de techniek is, zo bescheiden doet hij meestal zijn werk. Bij het importeren worden foto’s automatisch geanalyseerd en voorzien van trefwoorden. Bij Photoshop Elements kun je dit uitzetten. Zoektermen kun je vervolgens via een eenvoudig zoekveld intypen, of dicteren zoals bij Apple en Google. Het resultaat zijn alle foto’s uit je archief waarin de software het gezochte object heeft gevonden. Photoshop Elements en EyeEm Vision verraden welke trefwoorden ze allemaal toegewezen hebben, de andere systemen houden zich op de vlakte. Te algemene benamingen of fouten kun je zo niet zien noch corrigeren. Vooral voor professionele fotografen opereren deze slimme hulpjes nog te veel in het geheim. Vooral aangezien ze hun trefwoordenverzameling niet in de metadata van JPEG’s, TIFF’s en PNG’s schrijven.

Geïntegreerde netwerken

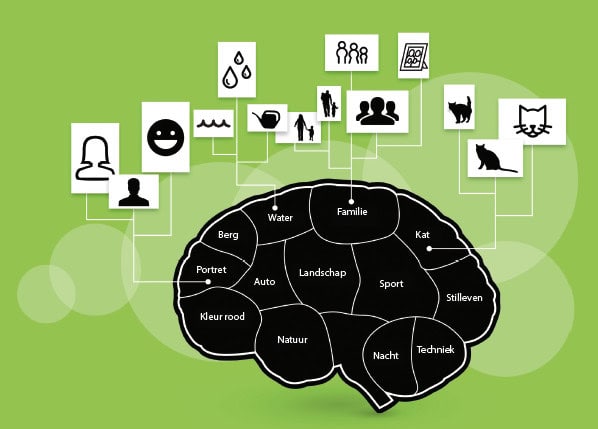

Kunstmatige neurale netwerken (KNN) lossen een lastig probleem in mens-machinecommunicatie op. Als mens verwerken en interpreteren we namelijk continu spraak en beelden, ook abstracte content zoals de sfeer. Maar we lopen vast op als we computers met behulp van regels en instructies dit type waarneming moeten ‘leren’. Het hersenonderzoek is nog niet zover dat we de werking van de hersenen in regels kunnen gieten. Daartegenover kun je heel goed bestuderen hoe mensen zich cognitieve vaardigheden eigen maken. Dat doe je namelijk door trainen aan de hand van voorbeelden, trial and error, en bevestiging en beloning. Op basis van deze inzichten bouwen de onderzoekers kunstmatige neurale netwerken. Op deze manier kan het samenspel van de menselijke zenuwcellen gesimuleerd worden, die bij kijken of spreken geactiveerd worden.

Gedrag van neuronen nabootsen

Zo’n netwerk bestaat simpel gezegd uit miljoenen neuronen die via paden met elkaar zijn verbonden. Aan elk van die paden hangen gewichten die de sterkte van de verbinding weerspiegelen. Dankzij dit netwerk kunnen deze eenvoudige bouwstenen zich aaneenkoppelen tot willekeurig complexe functies. Voordat zo’n netwerk zich tot een systeem voor fotoclassificatie kan ontwikkelen, heb je extreem veel getagde foto’s nodig. Voer je het systeem bijvoorbeeld met een paar honderd foto’s van honden, dan kan het fotobewerkingsfilters leren om zulke motieven tot universele structuren, lijnen en kleurpatronen te reduceren en daaruit karakteristieke onderdelen et isoleren. Denk bijvoorbeeld aan vacht, ogen, neus, bek, gezicht. Train je het systeem verder op landschapsfoto’s, dan komen concepten als bergen, meren, weilanden en bossen naar boven. De netwerken kunnen ook abstracte begrippen als lente, zomer, herfst en winter leren. Daarbij zorgt iedere voorbeeldfoto ervoor, dat de parameters steeds een beetje verder worden verfijnd.

De training is voltooid wanneer de herkenningsratio niet meer hoger kan worden. Dan heeft het netwerk geleerd waarmee het objecten in foto’s kan herkennen. Train je een netwerk daarentegen met foto’s die op beeldkwaliteit gecatalogiseerd zijn, dan leert het iets andere filters, die harmonische beeldverdeling, fijne scherpte-onscherpte verdelingen, geslaagde kleurcombinaties enzovoort kunnen ontdekken.

Een neuraal netwerk is zo goed als de gebruikte trainingsdata. En als je bij de bron zit heb je een voorsprong. Google, Flickr en Instagram hebben bijvoorbeeld al miljoenen foto’s via hun platformen verzameld, EyeEm kan op 80 miljoen foto’s terugvallen. Een zeer ambitieus project op dit gebied is ImageNet, een fotodatabase die alleen voor niet-commerciële en onderzoeksdoeleinden gebruikt mag worden. Op dit moment bevat hij vijftien miljoen foto’s, die in een hiërarchisch opbouwde boom van categorieën zijn onderverdeeld. Uiteindelijk moet hij vijftig miljoen foto’s omvatten met vijfhonderd tot duizend foto’s per categorie.

ImageNet

Onderzoekers van de universiteit van Princeton hebben het concept van ImageNet in een artikel tot in detail beschreven. Hierin wordt duidelijk hoeveel werk en planning er achter een hoogwaardige dataverzameling zit. Iedere categorie moet een voorbeeldverzameling bevatten. Deze laat het object vanuit zoveel mogelijk perspectieven en ook in veel verschillende uitsnedes zien. Alleen zo kun je garanderen dat de neurale netwerken het concept achter iedere categorie begrijpen. En dat ze een mens bijvoorbeeld onafhankelijk van huid- en haarkleur, kleding, hoofdbedekking en lichaamsomvang kunnen herkennen. Picturio en EyeEm hebben vastgesteld dat ze het netwerk met de kennis van experts moeten voeden. Dit om gefundeerde fotobeoordelingen te krijgen.

Appu Shaji, hoofd van de R&D-afdeling bij EyeEm, vertelt c’t: “We hebben geëxperimenteerd met community ratings, maar moesten constateren dat het systeem alleen menselijke voorkeuren leert – bijvoorbeeld voor grappige memes.” Maar EyEm wil foto’s eruit lichten die een duidelijk verhaal vertellen. Daarom heeft het bedrijf professionele fotografen en fotoredacteuren in de arm genomen. En heeft op basis van hun oordeel een trainingsverzameling van honderdduizend foto’s opgebouwd.

Welke gegevens gaan de cloud gestuurd?

Google verzamelt alle gegevens op zijn eigen cloudservers, zowel van het neurale netwerk, de metadata als de foto’s zelf. De foto’s worden onder andere beoordeeld om gepersonaliseerde advertenties mogelijk te maken. Excire daarentegen is een plug-in voor Lightroom en werkt uitsluitend lokaal. Apple Foto’s analyseert gezichten en objecten eveneens lokaal en slaat de metadata op het betreffende apparaat op. Maar de fabrikant gebruikt een ‘differential privacy’-concept en behoudt zich het recht voor geanonimiseerde data ter analyse naar Cupertino te sturen. Met differential privacy worden methoden aangeduid die een dataset veranderen. En wel zo dat je de identiteit van de persoon er niet meer uit te halen is, maar er nog wel een statistische analyse mogelijk is. Je neemt bijvoorbeeld een steekproef en maakt de data onleesbaar. Hoe Apple de data precies anonimiseert, welke apps data doorsturen en welke data er worden gestuurd, blijft onduidelijk.

Picturio extraheert volgens de producent de kenmerken lokaal en stuurt ze als hashes naar de server. Deze beoordeelt en groepeert ze. En synchroniseert ze bij het inzoomen via objectherkenning. EyeEM stuurt een verkleinde preview van de foto naar de server van het bedrijf. Daar wordt hij alleen in de cache bewaard en na rating en tagging weer verwijderd.

Toekomstmuziek

Objectherkenning in foto’s werkt verbazingwekkend goed. Vooral Google demonstreert op indrukwekkende wijze hoe goed en volledig een machine foto’s kan analyseren. Dit doel bereikt het databedrijf niet alleen met neurale netwerken. Het gebruikt zijn totale kennisnetwerk om uit direct herkende objecten belangrijke extra informatie af te leiden. Wanneer Google zijn netwerk bijvoorbeeld op de Eiffeltoren traint, kan het ‘Parijs’ en ‘Bezienswaardigheid’ simpelweg via zijn Knowledge Graph aanvullen. De fabrikanten gebruiken ook (synoniemen-)woordenboeken om hun scores te verhogen. Aesthetic ranking werkt niet perfect, maar helpt wel bij het maken van keuzes. Vooral EyeEM beoordeelt foto’s verbazingwekkend gedifferentieerd en neutraal. In al je enthousiasme over wat de netwerken zelfstandig kunnen ontdekken, mag je een ding niet vergeten: het is minstens zo belangrijk wat ze níet vinden. En dat kun je op het moment alleen bij Photoshop Elements en EyeEM Vision enigszins uitproberen.

Alle systemen wijzen nog genoeg onverenigbare en foute tags of gewoon te weinig tags toe. Vooral in het professionele segment zal daarom niet per se de aanbieder met het grootste en diepste netwerk winnen, maar degene die efficiëntie met betrouwbaarheid en controle weet te combineren. Excire werkt daarom aan een uitgebreidere categorieboom en een Pro-versie die de gebruiker meer invloed geeft. Voor de doorsnee gebruiker lijken de fabrikanten de voorkeur te geven aan blackbox-oplossingen, zoals Apple en Google Foto’s demonstreren. Daar zit vermoedelijk de overtuiging achter dat AI-gebaseerd zoeken binnenkort zo perfect is, dat handmatige correctie overbodig is.

Apple Foto's

Sinds een jaar organiseert Apple je fotoarchief op macOS en iOS apparaten met de app Foto’s. Het programma herkent gezichten, emoties, objecten en scène’s – alles bij elkaar kan het programma 4432 categorieën onderscheiden. De intelligentie zit niet verstopt op een ver verwijderde server aan de overkant van de oceaan. Hij analyseert de foto’s lokaal op het betreffende apparaat.

Hiermee onderscheidt Apple zich duidelijk van concurrent Google die alle foto’s voor het analyseren naar zijn servers uploadt. Het bedrijf behoudt zich hiermee het recht voor om met de gewonnen gegevens gepersonaliseerde reclames aan te sturen. Of om de data aan derden door te sluizen. Daarom kunnen mensen in bijvoorbeeld Duitsland wel de gezichtsherkenning van Apple gebruiken. Maar niet die van Facebook (Moments) en Google (Foto’s). Bij de twee laatsten is die functie namelijk om juridische redenen voor Duitsland uitgeschakeld. Die rem op de dataoverdracht betekent ook een stuk minder gemak. Objecten, gezichten en trefwoorden worden dan niet tussen je apparaten gesynchroniseerd.

Voer je in het zoekveld een begrip in, dan presenteert Foto’s eerst een lijst met vindplaatsen. Daarbij maakt de app verschil tussen plaatsen, albums, aandenkens en de automatisch toegewezen categorieën. Via een info venster kun je je zelfgemaakte trefwoorden, beschrijvingen en waarderingen zien. Deze worden bij het zoeken eveneens meegenomen. Toch is er een kloof tussen AI en gebruiker. Het info venster laat bij een foto alleen de trefwoorden zien die je als gebruiker zelf gegeven hebt. Maar niet de automatisch toegewezen categorieën. Zo blijft onduidelijk welke foto’s correct en uitputtend beschreven zijn – en welke zoekbegrippen het programma eigenlijk kent. Je hebt gewoon geen overzicht, ondanks alle intelligentie. Tip: door een losse letter in het zoekveld te typen, krijgt je wat van de toegewezen categorieën te zien.

In de test herkende de foto zoekfunctie eigenhandig dieren, planten, vruchten en landschappen. Ook sommige hondenrassen of bloemen- en plantensoorten (Orchidee, aardveil) worden herkend. Bezienswaardigheden behoren ook tot het assortiment. Handig is dat je niet hoeft te typen, de spraakinvoer met Siri werkte eveneens erg goed.

+ uitgebreide herkenning, werkt lokaal

– synchroniseert niet tussen apparaten

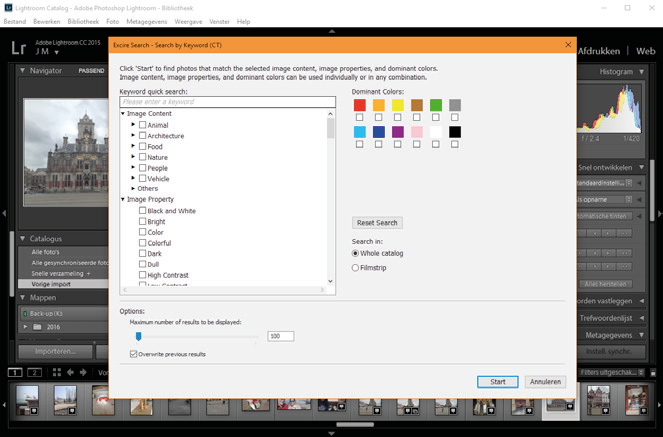

Excire

Met Excire verkoopt de Pattern Recognition Company (PRC) een gecombineerde techniek die objecten in foto’s herkent. En bovendien aan de hand van een voorbeeldfoto in het archief kan zoeken naar overeenkomstige onderwerpen. De techniek is alleen al daarom interessant, omdat hij uitsluitend lokaal op de computer van de gebruiker werkt. Hij is dus niet aan een sociaal netwerk of bepaalde hardware gekoppeld. Het eerste product voor fotografen is een Lightroom plug-in voor Windows en macOS. Ontwikkelaars kunnen een licentie nemen op een SDK.

Lightroom zelf biedt van huis uit alleen gezichtsherkenning. Trefwoorden moet je handmatig invoeren. Excire belooft met zijn plug-in meer gemak en minder gedoe bij het zoeken. Na een snelle indexeringsronde kun je het zoekvenster met een sneltoets oproepen. In het invoerveld vind je dan een lijst van alle door Excire toegewezen trefwoorden. In tegenstelling tot Apple en Google hoef je hier dus niet te raden welke begrippen het systeem überhaupt kent. Alleen kent de zoekfunctie op het moment niet meer dan tweehonderd trefwoorden – waarmee je je verzameling slechts grof kunt filteren. De zoekfunctie vindt aan de hand van een geselecteerde foto visueel overeenkomstige motieven. Deze is ook te gebruiken om zoekresultaten te verfijnen. Bijvoorbeeld als je uit duizenden gevonden strandfoto’s alleen de exemplaren die tijdens de schemering zijn genomen eruit wilt filteren. Excire presenteert het resultaat als Lightroom verzameling.

Tijdens de test herkende de software typische landschaps- en stadsonderwerpen als bergen, meren, bomen, gebouwen, kerken erg goed. Ook identificeerde hij personen en maakte hij verschil tussen kinderen en volwassenen. Hogere categorieën die de opnametechniek, scènes en stemmingen karakteriseren kent Excire niet. Denk aan ‘landschap’, ‘studio-opname’ of ‘stilleven’. Met dat soort categorieën kun je foto’s nog gerichter zoeken en zelfs semi-automatisch laten corrigeren. Heb je al een omvangrijke categorieboom heeft opgebouwd? Dan zou het fijn zijn als Excire ook de al aanwezige beschrijvingen en trefwoorden zou meenemen. En als hij ook de eigen resultaten in het trefwoordenveld vastlegt. Op het moment kun je als gebruiker niet controleren welke foto’s je zelf zou moeten aanpassen. Je wilt ze later ook weer terug kunnen vinden.

+ werkt lokaal

– kent weinig begrippen

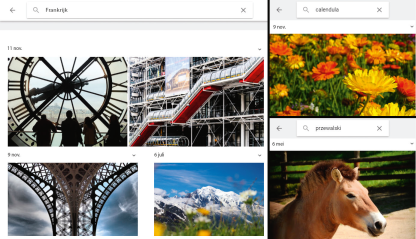

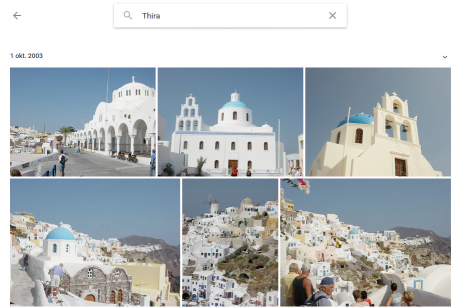

Google Foto's

Google Foto’s is een cloud oplossing die de belangrijkste platformen ondersteunt. Op de desktop fungeert de browser als client, voor Android en iOS is er een app. De Google-apps laten goed zien wat de automatisering in huis heeft. Ze wijzen trefwoorden toe en sorteren foto’s automatisch in albums. Bovendien proberen ze bijzondere gebeurtenissen te herkennen en optimaliseren ze foto’s afhankelijk van het onderwerp. Als Googles AI te moet helpen bij het zoeken, sorteren en retoucheren, is er wel een voorwaarde. Je moet eerst al je foto’s op Googles servers stallen. Dat heeft twee grote nadelen. Google gebruikt de data ook voor zijn eigen (reclame-) doeleinden. En het programma heeft voor het toewijzen van trefwoorden merkbaar langer nodig dan de lokale fotoanalyse- systemen.

Googles netwerk werkt grondig en maakte in de test veel indruk door zijn detailkennis. Het onderscheidt duizenden begrippen, van dieren en mensen tot bezienswaardigheden aan toe. Het kent niet alleen bloemen, maar ook anjers, tulpen en lavendel. Het maakt zelfs verschil tussen skiërs en langlaufers, ook al gaat dat niet in alle gevallen goed. Het zoekt lachende en treurige gezichten uit het archief. Speurt naar landschapsfoto’s en portretten. Natuurlijk kan het ook gezichten herkennen. De beeldoptimalisatie bestaat uit een autocorrectie, die licht, kleurintensiteit, contrast / scherpte en vignettering instelt afhankelijk van het onderwerp. Deze parameters kun je aanpassen, waarbij de vignettering automatisch het hoofdonderwerp accentueert en de kleur-/contrastregelaars huidtinten ontzien. De creatieve kant beperkt zich tot vijftien looks, waarvan twee in zwart-wit.

De AI biedt overvloedige informatie en zorgt voor veel gemak – tenminste zolang je in de Googlewereld blijft. Je kunt de automatisch verkregen kennis niet delen met de buitenwereld. Welke trefwoorden een foto heeft, krijgt je als gebruiker niet te horen. En bij het exporteren van foto’s blijven de trefwoorden in het systeem achter. Overigens kun je de foto’s naar keuze in de originele grootte of in ‘hoge kwaliteit’ uploaden. Hierbij verbruiken originele foto’s het tot 15 GB beperkte quotum natuurlijk sneller. De optie ‘hoge kwaliteit’ garandeert een onbeperkte opslag, maar verkleint foto’s met een te hoge resolutie tot 16 megapixel.

+ zeer omvangrijke herkenning

– pure cloudtoepassing

Picturio

Picturio is een zelfstandige desktopfotoviewer, die helpt bij het bekijken en uitzoeken van omvangrijke fotoshoots. Het programma combineert verschillende intelligente technieken om op elkaar lijkende foto’s te groeperen, te vergelijken en hun kwaliteit te beoordelen. Het programma zet de overblijvende crème de la crème desgewenst in een Lightroom catalogus. Of het maakt instant previews voor internet en klanten aan. De Lightroom plug-in werkte in de test helaas niet. Op het moment is er alleen een Windowsversie, een versie voor macOS zit nog in de pipeline.

Bij Picturio word je als gebruiker ondersteund door intelligente algoritmes, zodat je makkelijker kunt vergelijken en kiezen. In de linker balk selecteer je de te analyseren fotomappen. In het midden is er veel ruimte om de foto’s te bekijken. De rechter balk geeft informatie over de opnamegegevens en over de helderheidsverdeling middels een histogram. Een gesegmenteerd, rond symbool in de linker bovenhoek van iedere foto geeft aan, hoe Picturio de kwaliteit inschat. De beste opname van een stapel foto’s zet het bovenaan.

Als je klikt op een fotostapel zet Picturio de afzonderlijke beelden naast elkaar. Om details en scherpte te vergelijken, zoom je met het muiswiel in op een gedeelte van een van de foto’s. Daarop zet Picturio automatisch alle foto’s in de stapel op dezelfde uitsnede. Dit werkt betrouwbaar als de kijkhoek van de foto’s niet te veel afwijkt. Het herkennen en beoordelen gebeurt op de servers van de producent. Picturio-CTO Mike Szabolcs verzekert c’t dat daarvoor niet je originele foto’s, maar alleen de sterk geabstraheerde kenmerken geüpload worden. Achter de intelligente zoomfunctie zit een neuraal netwerk voor het herkennen van objecten. De esthetische beoordeling verloopt via halfautomatisch gevonden features, een heuristiek en een beslissingsboom. Het velde in de test uitsluitend transparante beoordelingen, maar deed dat nog niet zo goed als EyeEM. Vermoedelijk was dat te wijten aan de zwakkere databasis.

+ interactieve tools om foto’s te vergelijken

– werkt alleen met internetverbinding

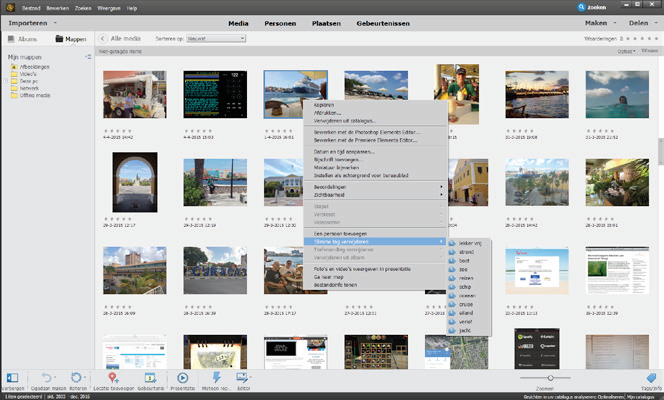

Photoshop Elements en Lightroom

Het automatisch toewijzen van trefwoorden in Photoshop Elements 15 lijkt op dat van Apple Foto’s. De functie herkent gezichten en deelt zogenaamde slimme tags (smart tags) uit voor objecten, bezigheden en emoties. Het zoeken verloopt via een invoerveld voor trefwoorden en een thematisch overzicht. Hierin presenteert Photoshop Elements de meest voorkomende slimme tags inclusief preview. Dat zijn bijvoorbeeld begrippen als natuur, familie en dier, maar ook bezigheden als spelen, reizen of lachen. Het zoeken naar trefwoorden houdt automatisch rekening met toegewezen slimme tags, eigen categorieën, beschrijvingen en de mapnamen. Het herkennen werkt goed, maar produceert nog te veel fouten en onnauwkeurigheden.

De snelmenufunctie ‘Slimme tag verwijderen’ geeft een lijst van de automatisch herkende foto-eigenschappen. Daarmee geeft het je als gebruiker wat overzicht en controle terug. Omdat je foute toewijzingen afzonderlijk en per foto moet verwijderen, wordt de tijdwinst van de automatische trefwoordtoewijzing weer teniet gedaan. De trefwoordenlijsten onthullen ook een principiële zwakte. De smart tags zijn vaak van toepassing, maar zorgen niet voor een consistente trefwoordentoewijzing van je fotoarchief. Zo gaf Photoshop Elements aan vrijwel identieke opnames van een vlinder tussen vier en tien trefwoorden. Maar Adobe maakt de zwakke plekken van zijn techniek hier tenminste transparant; bij Apple en Google glippen dat soort foto’s er ongemerkt tussendoor.

Gebruikers van Lightroom moeten zich voorlopig tevreden stellen met alleen gezichtsherkenning of extra betalen voor de Excire-plugin. Maar de vooruitzichten op een ingebouwde objectherkenning zijn niet slecht. Want in de online-versie Lightroom on the Web is Adobe enkele maanden geleden met een bètatest van deze techniek begonnen. Het doel is om feedback van Lightroom-gebruikers te verzamelen.

+ werkt lokaal en transparant

– omslachtige handmatige correctie

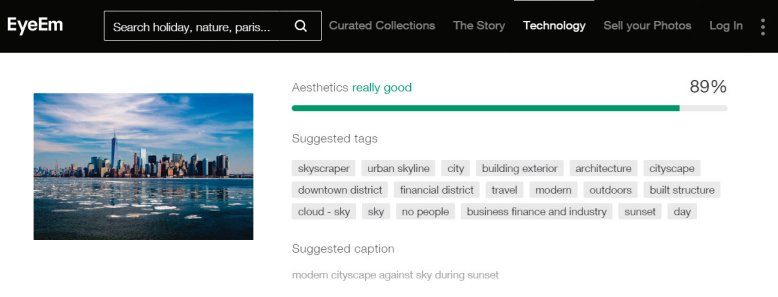

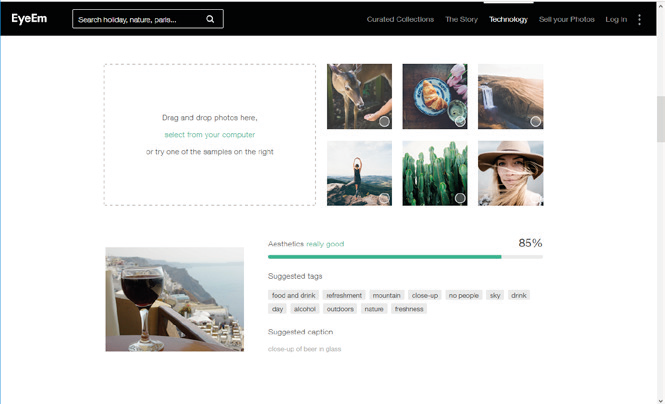

The Roll/EyeEm Vision

Het semiprofessionele en -commerciële fotoplatform EyeEM komt voort uit de Berlijnse start-upscene. De algoritmes stammen van Appu Shaji, de oprichter van sight.io. Dit bedrijf is overgenomen door EyeEM. Als je deze techniek even snel wilt testen, kun je foto’s via de website van de producent uploaden. Het systeem beschrijft foto’s zeer uitvoerig en legt daarbij het zwaartepunt op fotografische aspecten. Het herkent niet alleen objecten, maar ook sfeer en scènes. Bijvoorbeeld of het om een portret gaat, of dat de persoon naar beneden of recht voor zich uit kijkt. Ook eigenschappen als ‘close-up’ en ‘freshness’ duiken in de beschrijvingen op.

De iOS-app The Roll deelt trefwoorden uit, maakte fotobeschrijvingen, beoordeelt de foto’s op esthetische criteria en sorteert ze daarop. Via een simpel invoerveld kun je op trefwoorden zoeken. De app presenteert gangbare categorieën in een overzicht met previews. Dit wordt geflankeerd met de beste foto’s uit de verzameling en de highlights van de week. De beoordelingen zijn weliswaar niet perfect, maar wel erg handig. Niet in de laatste plaats omdat ze iets speels toevoegen aan het monotone proces van de keuring. Want als het programma dezelfde foto’s het beste vindt, voel je je in je mening bevestigd. Het kan zijn dat het jouw persoonlijke topper maar middelmatig vindt. In dat geval kun je de foto analyseren en je eigen oordeel nog eens kritisch overwegen. Veel foto’s vind je waarschijnlijk alleen maar mooi, omdat ze een grappig moment vastleggen. Of omdat de persoon erop erg betoverend lacht.

Alles bij elkaar lijkt EyeEM een erg neutraal, gedifferentieerd beeld van het begrip esthetische foto gevonden te hebben. Dit is vermoedelijk aan de goede trainingsdata te danken is. Zwaar gephotoshopte reclamemodellen zijn in elk geval geen garantie voor een hoge ranking. Met karakterfoto’s kan de software uitstekend overweg. Het propageert geen schoonheidsideaal en heeft ook geen voorkeur voor een bepaalde huidskleur. Maar het programma vertoonde in de test een probleem met opvallende HDR-effecten en overschatte vaak een saaie landschapsfoto.

The Roll-app is na het schrijven van dit artikel in december uit de App store gehaald. EyeEM meldt op zijn website dat de functies van The Roll de komende maanden worden geïntegreerd in EyeEm. En dat de app wordt gestopt.

+ aesthetic ranking

– alleen voor iOS, internetverbinding vereist

Overzichtstabel

Tip

Krijg direct toegang tot alle beschikbare edities op je laptop, tablet of smartphone.

Praat mee