Google wil complexe zoekopdrachten beter beantwoorden

Google verandert zijn zoekalgoritme om complexe vragen beter te begrijpen. Daarbij zorgt BERT voor een grote sprong voorwaarts.

Lees verder na de advertentie

Google-gebruikers typen steeds moeilijkere zoekvragen in op de zoekbalk – maar desondanks levert de zoekmachine vaak goede resultaten. Maar niet altijd: hoewel de ontwikkelaars de afgelopen 15 jaar het spraakbegrip van Google aanzienlijk verbeterd en uitgebouwd hebben, “begrijpen we de zoekopdrachten vaak niet altijd goed”, aldus Googles vice-president Pandu Nayak.

De uitdaging: veel mensen typen vaak simpelweg een aantal termen in en hopen dat dat Google daar iets van kan maken. Om ervoor te zorgen dat dit in de toekomst beter werkt, voert de zoekmachine nu een grote verandering in zijn zoekalgoritme door. Die update zal de samenstelling van de zoekresultaten beïnvloeden. Volgens Google gaat het daarbij om een tiende van het totaal aantal opdrachten. Het moet de grootste sprong voorwaarts van de afgelopen vijf jaar gaan worden.

BERT analyseert hele zinnen

Tip

Krijg direct toegang tot alle beschikbare edities op je laptop, tablet of smartphone.

Het algoritme gebruikt met BERT een nieuwe techniek bij het machinaal verwerken van natuurlijke taal (Natural Language Processing, NLP). De afkorting BERT staat voor Bidirectional Encoder Representations from Transformers. Google heeft BERT in november 2018 geïntroduceerd en als opensource uitgebracht.

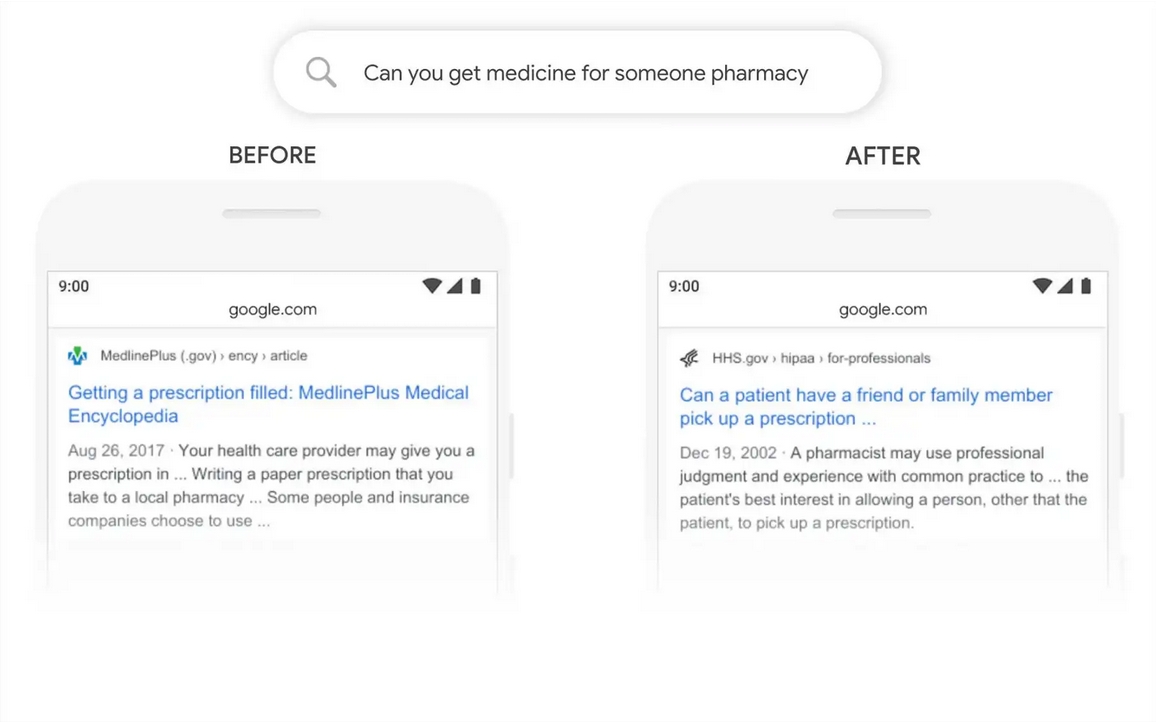

Het BERT-model verwerkt woorden in relatie tot elkaar en bekijkt ze in de context. Google noemt als praktijkvoorbeeld de zoekopdracht “Can you get medicine for someone pharmacy”. De vragensteller wil weten of het mogelijk is om een medicijn voor iemand anders bij een apotheek op te halen.

Met het BERT-model begrijpt Google dat “for someone” een belangrijk deel is. Het oude systeem had de zoekopdracht in losse woorden opgedeeld en zich op de hoofdtermen “medicine” en “pharmacy” geconcentreerd. Als resultaat zou de gebruiker dan een paar lokale apotheken krijgen, maar geen antwoord op de eigenlijk gestelde vraag. BERT pakt de hele zijn en moet dan beter begrijpen wat de gebruiker eigenlijk wil weten.

Daarvoor let het algoritme ook meer op preposities om de correcte betekenis van een zin te achterhalen. “Met BERT kan de zoekmachine ook de nuances begrijpen en veel relevantere resultaten leveren”, verklaart Pandu Nayak in een Google-blog. In eerste instantie werkt dat echter alleen met zoekopdrachten in het Engels en in de VS. Andere talen en landen moeten snel volgen.

Als de juiste woorden ontbreken

Volgens Google is 15 procent van de dagelijkse zoekopdrachten nog nooit eerder gesteld. Veel gebruikers laten vaak de belangrijkste woorden weg om een zoekopdracht zinvol te formuleren, denkt Nayak. “Het is dan onze taak om te achterhalen waar ze naar op zoek zijn en de juiste informatie te leveren. Geheel onafhankelijk van hoe ze de zoektermen spellen of combineren.” Een compleet spraakbegrip blijft een continue uitdaging.

- AI en cognitieve vaardigheden

- Werken met gestructureerde processen

- Gaat AI werknemers vervangen?

- c’t security-checklist 2026

Tip

Krijg direct toegang tot alle beschikbare edities op je laptop, tablet of smartphone.

Praat mee