CNET betrapt op het gebruik van AI zoals ChatGPT voor hun teksten

De nieuwswebsite CNET zal in de toekomst duidelijk aangeven welke artikelen door een computer gegenereerd zijn. Dit is na kritiek omdat er fouten in de artikelen stonden. Bovendien was men niet transparant over het gebruik van AI zoals ChatGPT voor deze artikelen.

Lees verder na de advertentie

Uit de hand gelopen experiment

De hoofdredacteur van CNET, een Amerikaans nieuwsportaal, beschouwt teksten geschreven door kunstmatige intelligentie als een experiment en heeft aangegeven dat de technologie verder zal worden getest. Er zijn echter al enkele dagen geen artikelen gepubliceerd die op deze manier zijn geschreven, de meest recente dateren van vorige vrijdag.

Tip

Krijg direct toegang tot alle beschikbare edities op je laptop, tablet of smartphone.

Een eerder prominent geadverteerde tekst is nu volledig gecorrigeerd. Hoofdredacteur Connie Guglielmo van CNET heeft geen opmerkingen gemaakt over de kritiek dat het gebruik van de AI-tekstgenerator weinig transparant was. De technologie wordt nu verder getest “om te onderscheiden tussen hype en werkelijkheid”.

CNET gebruikt AI voor publicatie van artikelen, ondanks kritiek op fouten

Het Amerikaanse technologieportaal CNET had gedurende enkele weken artikelen gepubliceerd die door kunstmatige intelligentie waren geschreven. Guglielmo legt nu uit dat de AI-tool informatie verzamelde voor de adviesartikelen en dat net als alle andere artikelen, de teksten werden nagekeken en bewerkt door een professionele redacteur.

CNET blijft AI gebruiken voor verhalen, maar benadrukt controle en correctie van fouten

CNET gebruikt diverse tools en technologie om verhalen te creëren, maar dit verandert niets aan de manier waarop de artikelen gecontroleerd en geredigeerd worden. Als er later fouten worden gevonden, worden deze gecorrigeerd. In het geval van een van de door Guglielmo gelinkte artikelen was een uitgebreide correctie nodig. Zoals nu vermeld staat in de toelichting over samengestelde rente, stond eerder dat met een spaarsaldo van 10.000 dollar en een rente van 3% aan het einde van het eerste jaar, je 10.300 dollar zou kunnen verdienen, maar dit is niet correct, het moet $300 zijn.

Gratis het laatste nieuws ontvangen over ChatGPT? Schrijf je in voor de nieuwsbrief:

''Cruciale fouten''ontdekt volgens Futurism

Het Amerikaanse portaal Futurism heeft meerdere fouten ontdekt in dezelfde tekst die door CNET gepubliceerd werd. Sommige hiervan zijn eenvoudige fouten die deskundigen meteen zouden herkennen, maar het adviesartikel richt zich voornamelijk op mensen met weinig voorkennis en voor hen kunnen deze fouten problematisch zijn.

De zelfverzekerde presentatie van fouten door ChatGPT leidt tot problemen

Daarnaast presenteert de kunstmatige intelligentie de fouten met een aanzienlijke zelfverzekerdheid. Bijvoorbeeld, ChatGPT werd betrapt op het verstrekken van niet-bestaande bronnen wanneer er om ondersteunend bewijs werd gevraagd. Zo heeft Buzzfeed de ChatGPT bot laten schrijven over de AI-teksten van CNET en moest de opdracht meerdere keren aanpassen “om feitelijke fouten te voorkomen”.

Gebruik van geautomatiseerde artikelen in het verleden

Al met al is het idee van geautomatiseerde artikelen niet nieuw, maar met de komst van ChatGPT is het onderwerp recentelijk relevant geworden. Al jaren worden er artikelen gepubliceerd die deels geautomatiseerd zijn, zoals aardbevingswaarschuwingen of samenvattingen van jaarverslagen. In deze artikelen worden alleen bepaalde nummers en termen op de juiste plaatsen ingevoegd. CNET, daarentegen, liet volledige teksten over een grote diversiteit aan onderwerpen door de AI genereren.

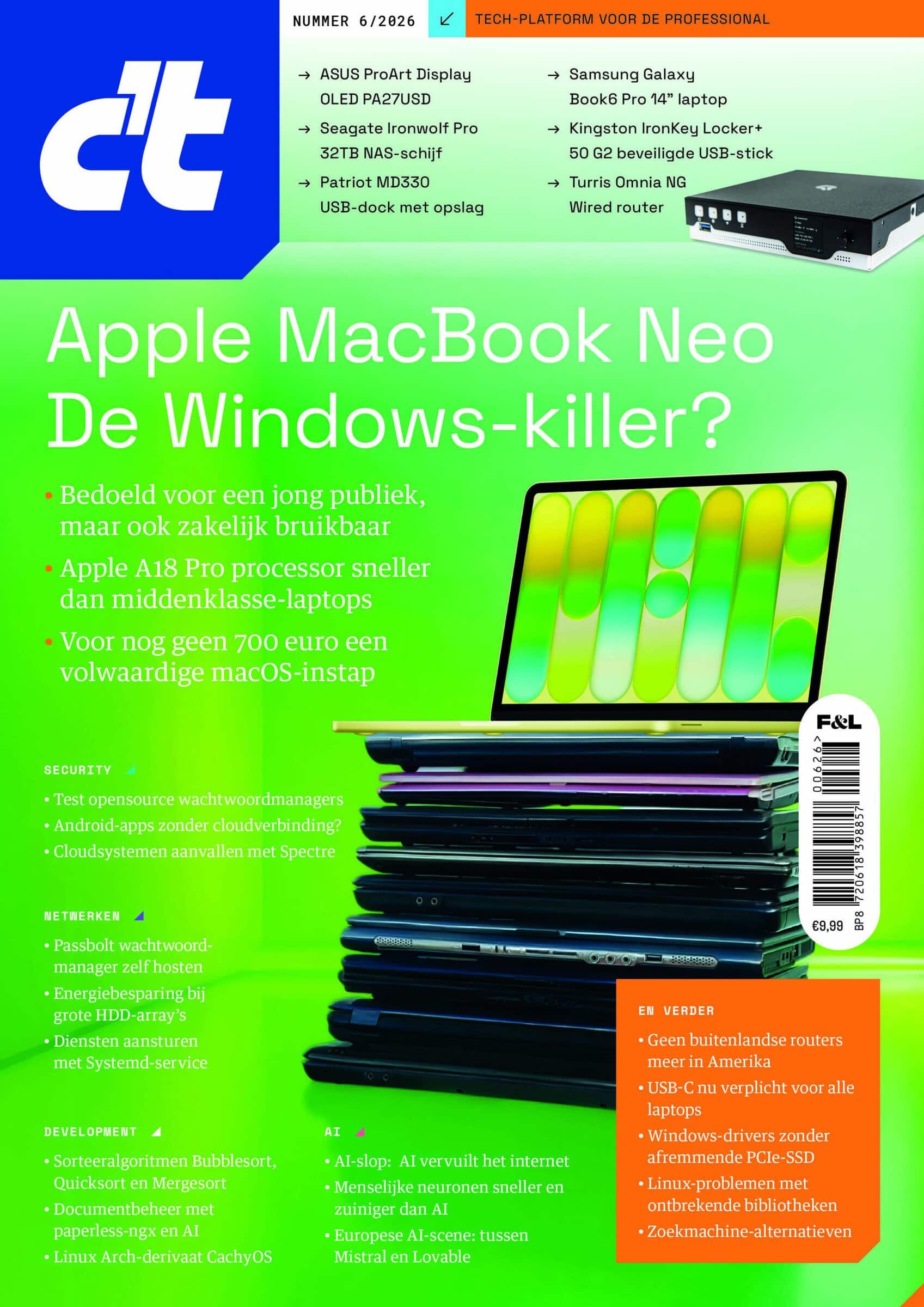

- MacBook Neo: Apple-laptop van 700 euro

- Vergelijking van 5 opensource-wachtwoordmanagers

- Energiebesparing bij AI-datacenters en het probleem van AI-slop

- USB-C, SSD-drivers, kwantum-pc’s en paperless-ngx

Tip

Krijg direct toegang tot alle beschikbare edities op je laptop, tablet of smartphone.

Meer over

- Uit de hand gelopen experiment

- CNET gebruikt AI voor publicatie van artikelen, ondanks kritiek op fouten

- CNET blijft AI gebruiken voor verhalen, maar benadrukt controle en correctie van fouten

- ''Cruciale fouten''ontdekt volgens Futurism

- De zelfverzekerde presentatie van fouten door ChatGPT leidt tot problemen

- Gebruik van geautomatiseerde artikelen in het verleden

Praat mee