Cloud of lokaal: een kwestie van de juiste keuze

Dit artikel is tot stand gekomen in samenwerking met onze partner GIGABYTE.

De opkomst van AI en de brede adoptie daarvan heeft het landschap van datacenters grondig veranderd. Waar in eerste instantie de AI-ontwikkeling zich in de cloud afspeelde, is er momenteel een trend zichtbaar richting de inzet van AI op on-premises servers.

Lees verder na de advertentie

De ontwikkeling van generatieve AI

De ontwikkeling van generatieve AI-modellen is in twee fasen op te delen. In eerste instantie is er de training, daarop volgt de inferentie. Voor het trainen zijn krachtige servers op grote schaal nodig, die gigantische datasets moeten verwerken over een lange periode.

Na het trainen volgt de inferentie: de praktijk hoe gebruikers AI ervaren via chatbots en tools. Dit vergt relatief minder rekenkracht, maar door de brede en toenemende adoptie van AI door het publiek groeien de benodigde hardware-eisen ook exponentieel.

Van cloud naar lokaal

Organisaties die AI willen inzetten, staan voor een keuze: gebruikmaken van de cloud-infrastructuur van een provider of investeren in eigen hardware.

Het voordeel van een provider is flexibiliteit. Door pay-as-you-go-modellen kunnen organisaties eenvoudig opschalen wanneer de behoefte groeit. Dit houdt de initiële uitgaven laag en maakt de instap in AI-diensten makkelijker.

Cloudgebruik is vooral ideaal voor kortstondige inzet, maar kan voor langduriger gebruik vanuit economisch oogpunt minder gunstig zijn. De kosten kunnen door intensief gebruik al op korte termijn flink oplopen en op de lange termijn aanzienlijk worden.

On-premises

On-premises infrastructuur vereist een initiële investering in servers, GPU’s, opslag en fysieke infrastructuur zoals koeling en ruimte. Systemen brengen doorlopende kosten met zich mee, zoals elektriciteit en onderhoud, die bijdragen aan de total cost of ownership.

Daar staat tegenover dat de kosten op lange termijn voorspelbaarder zijn, vooral wanneer AI-workloads stabiel en continu worden ingezet.

On-premises biedt daarnaast meer controle over gevoelige gegevens, omdat opslag en verwerking binnen het eigen netwerk van de organisatie blijven. Naarmate de geopolitieke situatie complexer en onzekerder wordt, groeit de behoefte om meer controle te houden over digitale infrastructuur, met name over componenten die verband houden met AI.

Voor zowel training als inferentie kan on-premises infrastructuur dus aanzienlijke voordelen bieden. In combinatie met een geoptimaliseerd gebruik van speciale GPU’s kan een on-premises-omgeving op de lange termijn een kostenefficiëntere optie zijn.

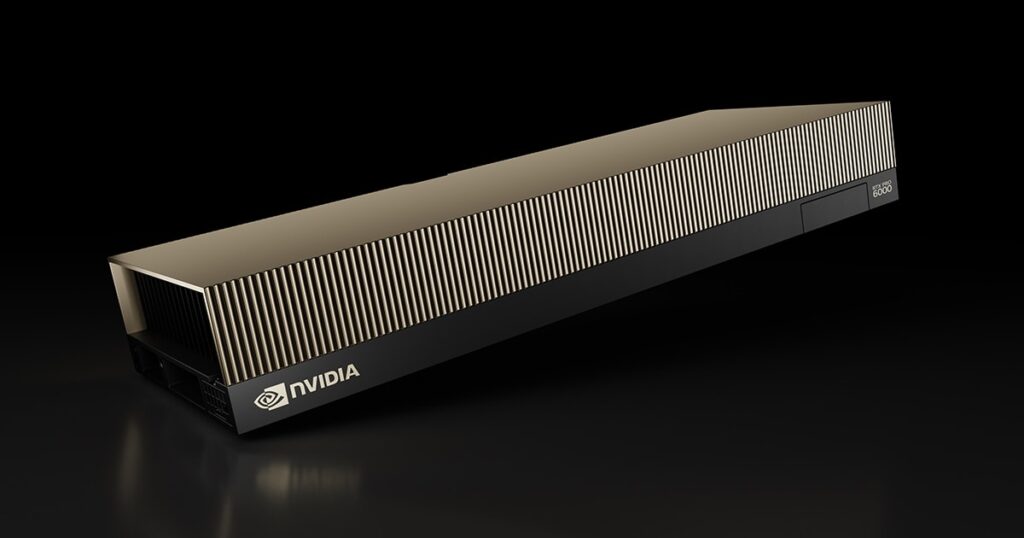

NVIDIA datacenter-GPU

De NVIDIA RTX PRO™ 6000 Blackwell Server Edition is de eerste datacenter-GPU gebaseerd op de NVIDIA Blackwell-architectuur. Deze GPU is ontworpen om de meest veeleisende AI- en grafische toepassingen te versnellen.

Met de RTX PRO™ 6000 kunnen bedrijven in sectoren zoals automotive, cloud- en financiële diensten, game-ontwikkeling en gezondheidszorg uitzonderlijke prestaties leveren voor workloads zoals generatieve AI, data-analyse en engineering-simulaties.

Ook organisaties die actief zijn in bijvoorbeeld contentcreatie, halfgeleiderproductie of genoomanalyse kunnen profiteren van het versnellen van rekenintensieve AI-gestuurde workflows.

De RTX PRO™ 6000 combineert krachtige functies in een passief gekoeld ontwerp, geschikt voor 24/7-gebruik in datacenters. Dankzij 96 GB ultrasnel GDDR7-geheugen en Multi-Instance GPU (MIG) kan elke GPU worden opgesplitst in vier volledig geïsoleerde instanties van 24 GB, zodat AI- en grafische workloads gelijktijdig uitgevoerd kunnen worden.

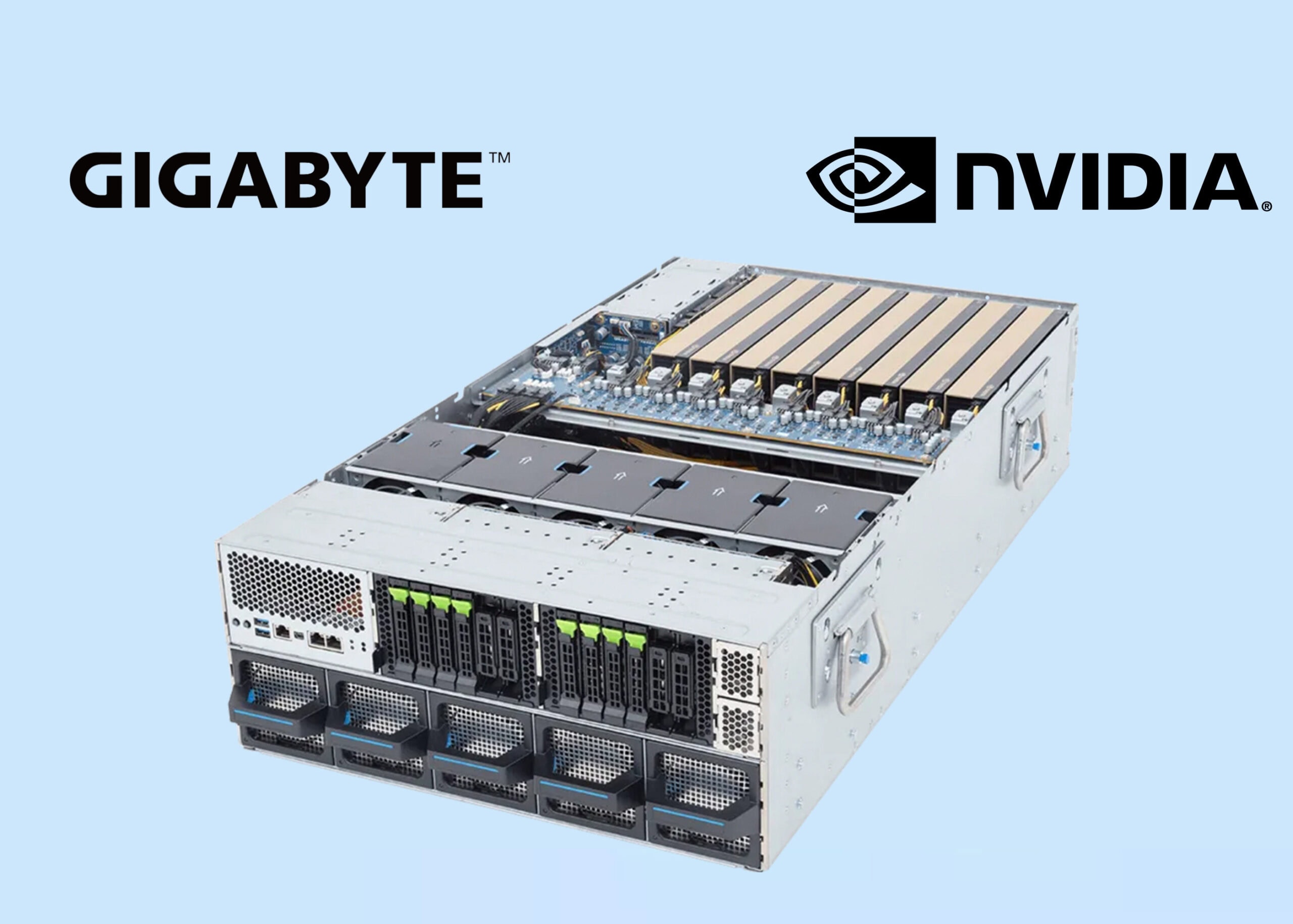

GIGABYTE en NVIDIA

Als een van de toonaangevende serverfabrikanten werkt GIGABYTE nauw samen met NVIDIA. Een enkele server kan worden uitgerust met maximaal acht GPU’s, waardoor enorme rekenkracht, geheugen en bandbreedte beschikbaar komen voor AI-toepassingen.

De GIGABYTE XL44-SX2-AAS1 is ontworpen om te voldoen aan de groeiende vraag naar AI-gestuurde professionele computing. Het betreft een high-density 4U NVIDIA MGX™ server, volledig geoptimaliseerd voor NVIDIA RTX PRO™ 6000 Blackwell Server Edition GPU’s.

Met ruimte voor maximaal acht dual-slot GPU’s is dit platform geschikt voor toepassingen zoals:

- AI-fabrieken

- enterprise-LLM-inferentie

- wetenschappelijke visualisatie

- next-generation digitale contentcreatie

Of het nu gaat om een onderzoeksomgeving, een AI-productiecluster of een 3D-contentpipeline: de XL44-SX2-AAS1 is ontworpen voor schaalbare, veilige en AI-versnelde professionele computing.

Tot slot

Nu AI-workloads steeds zwaarder en complexer worden, groeit de behoefte aan gespecialiseerde datacenterhardware. Door de combinatie van de GPU-technologie van NVIDIA en schaalbare serverplatforms biedt GIGABYTE organisaties de mogelijkheid om AI-toepassingen efficiënt en betrouwbaar on-premises te draaien.

Praat mee