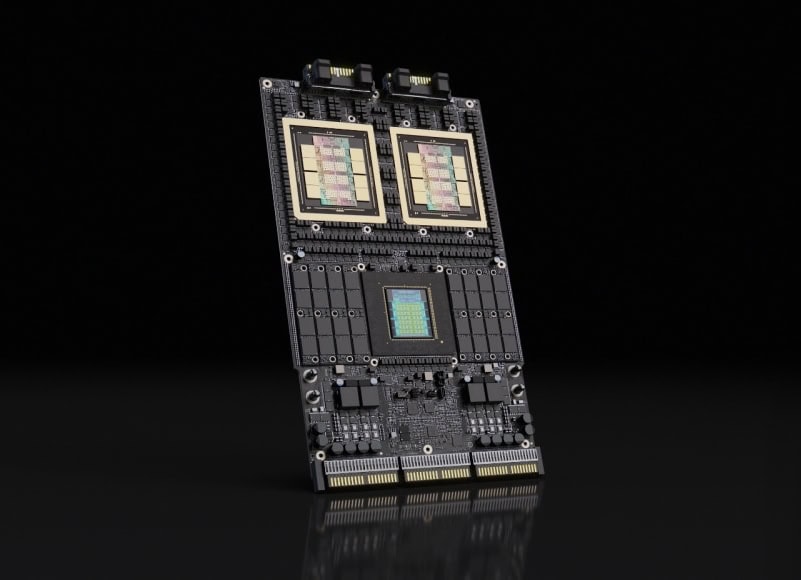

NVIDIA Vera Rubin: een nieuwe era voor agentische AI

NVIDIA heeft het NVIDIA Vera Rubin-platform aangekondigd, dat nieuwe schreden zet in agentische AI. Het platform brengt de NVIDIA Vera CPU, NVIDIA Rubin GPU, NVIDIA NVLink™ 6 Switch, NVIDIA ConnectX®-9 SuperNIC, NVIDIA BlueField®-4 DPU en NVIDIA Spectrum™-6 Ethernet-switch samen, evenals de nieuw geïntegreerde NVIDIA Groq 3 LPU – zeven nieuwe chips in volle productie om ’s werelds grootste AI-datacenters uit te breiden met een configureerbare AI-infrastructuur die is geoptimaliseerd voor elke fase van AI, van pretraining, posttraining en schaalbaarheid tijdens het testen, tot aan agentische inferentie aan toe.

De chips zijn ontworpen om samen te werken als één krachtige AI-supercomputer en ondersteunen elke fase van AI – van grootschalige pretraining, posttraining en schaalbaarheid tijdens het testen tot realtime agentische inferentie.

Vera Rubin

Het Rubin-platform, vernoemd naar Vera Florence Cooper Rubin – de baanbrekende Amerikaanse astronome wier ontdekkingen het begrip van de mensheid over het heelal hebben veranderd – omvat de NVIDIA Vera Rubin NVL72-oplossing op rack-schaal en het NVIDIA HGX Rubin NVL8-systeem.

Het Rubin-platform introduceert vijf innovaties, waaronder de nieuwste generaties van NVIDIA NVLink-interconnecttechnologie, Transformer Engine, Confidential Computing en RAS Engine, evenals de NVIDIA Vera-CPU.

Deze doorbraken zullen agentische AI, geavanceerd redeneren en grootschalige modelinferentie met een mix van experts (MoE) versnellen tegen tot wel 10 keer lagere kosten per token dan het NVIDIA Blackwell-platform. In vergelijking met zijn voorganger traint het NVIDIA Rubin-platform MoE-modellen met 4 keer minder GPU’s om de AI-adoptie te versnellen.

Denken vanuit agentische AI

Het NVIDIA Vera Rubin-platform is ontwikkeld voor het tijdperk van agentische AI en redenering, en ontworpen om meerstaps probleemoplossing en omvangrijke workflows met lange context op grote schaal aan te kunnen. Door kritieke knelpunten in communicatie en geheugenverplaatsing weg te nemen, geeft het platform een enorme boost aan inferentie, waardoor het meer tokens per watt en lagere kosten per token biedt in vergelijking met de NVIDIA Blackwell-architectuurgeneratie.

Transformer Engine

De Rubin GPU beschikt over een nieuwe Transformer Engine (TE) met hardwareversnelde adaptieve compressie om de NVFP4-prestaties (de innovatieve 4-bits drijvende-kommabijvoeging die is geïntroduceerd met de NVIDIA Blackwell GPU-architectuur) te verbeteren met behoud van nauwkeurigheid. Dit maakt tot 50 petaFLOPS aan NVFP4-inferentie mogelijk.

De Transformer Engine is volledig compatibel met NVIDIA Blackwell en zorgt voor naadloze upgrades, zodat eerder geoptimaliseerde codes moeiteloos kunnen worden overgezet naar het Vera Rubin-platform.

Derde-generatie Confidential Computing

De derde generatie van NVIDIA Confidential Computing breidt de beveiliging uit naar volledige rack-schaal met NVIDIA Vera Rubin NVL72. Dit platform creëert een uniforme, vertrouwde uitvoeringsomgeving voor alle 36 NVIDIA Vera-CPU’s, 72 NVIDIA Rubin-GPU’s en de NVIDIA NVLink™-fabric die deze naadloos met elkaar verbindt.

Het platform handhaaft gegevensbeveiliging in CPU-, GPU- en NVLink-domeinen. Met certificeringsservices voor cryptografisch bewijs van naleving combineert het enorme schaal met compromisloze bescherming, allemaal om ’s werelds grootste eigen modellen, trainingsgegevens en inferentieworkloads te beschermen.

Zesde generatie NVLink en NVLink-switch

De zesde generatie NVLink betekent een enorme sprong voorwaarts voor NVIDIA’s high-speed GPU-interconnect-fabric, die 72 NVIDIA Rubin-GPU’s verenigt in één prestatiedomein.

De Rubin GPU verdubbelt de prestaties van NVIDIA Blackwell en levert 3,6 terabyte per seconde (TB/s) aan bandbreedte per GPU en 260 TB/s aan connectiviteit met lage latentie voor snellere communicatie. In combinatie met NVIDIA® Scalable Hierarchical Aggregation and Reduction Protocol (SHARP)™, dat netwerkcongestie bij collectieve bewerkingen met wel 50 procent vermindert, versnelt deze interconnect van de volgende generatie het trainen en de inferentie voor ’s werelds grootste modellen, op schaal en zonder compromissen.

Tweede generatie RAS-engine

Het NVIDIA Vera Rubin-platform biedt veerkracht op rackschaal met geavanceerde betrouwbaarheidsfuncties. NVIDIA Rubin GPU’s beschikken over een speciale tweede generatie Reliability, Availability and Serviceability (RAS)-engine voor proactief onderhoud en realtime gezondheidscontroles zonder downtime. NVIDIA Vera CPU’s voegen verbeterde onderhoudsvriendelijkheid toe met Small-Outline Compression-Attached Memory Modules (SOCAMM) LPDDR5X en in-systeemtests voor de CPU-kernen.

Het rack introduceert modulaire, kabelvrije tray-ontwerpen voor 18x snellere assemblage en onderhoudsvriendelijkheid ten opzichte van NVIDIA Blackwell, gecombineerd met intelligente veerkracht en software-gedefinieerde NVLink-routing, wat continue werking garandeert en onderhoudskosten vermindert.

NVIDIA Vera-CPU

De NVIDIA Vera-CPU is ontworpen voor het verplaatsen van gegevens en agentic reasoning in versnelde systemen, met ondersteuning voor vertrouwelijke computing. Hij kan naadloos worden gecombineerd met NVIDIA GPU’s of onafhankelijk worden gebruikt voor analytics, cloud, orchestration, opslag en high-performance computing (HPC)-workloads.

Vera combineert 88 cores die door NVIDIA zijn ontworpen, tot 1,2 TB/s aan LPDDR5X-geheugenbandbreedte en NVIDIA Scalable Coherency Fabric om voorspelbare, energiezuinige prestaties te leveren voor data- en geheugenintensieve workloads.

Geïntegreerde NVIDIA NVLink-C2C-connectiviteit maakt coherente CPU-GPU-geheugentoegang met hoge bandbreedte mogelijk om het systeemgebruik en de efficiëntie te maximaliseren.

Brede ondersteuning van het ecosysteem

Producten op basis van Vera Rubin zullen vanaf de tweede helft van dit jaar verkrijgbaar zijn bij partners. Systeemfabrikanten zullen een breed scala aan servers leveren op basis van Vera Rubin-producten, zoals GIGABYTE in zijn GIGAPOD-systeem en de onlangs aangekondigde GIGABYTE G2L4-SD4.

AI- ontwikkelaars van geavanceerde modellen willen het NVIDIA Vera Rubin-platform gebruiken om grotere, krachtigere modellen te trainen en multimodale systemen met een lange context te bedienen met een lagere latentie en tegen lagere kosten dan met eerdere GPU-generaties.

Overstap naar POD-scale-systemen

AI-infrastructuur evolueert snel – van discrete chips en standalone servers naar volledig geïntegreerde rack-scale systemen, POD-scale implementaties, AI-fabrieken en soevereine AI.

Deze vooruitgang zorgt voor prestatieverbeteringen en verhoogt de kostenefficiëntie voor organisaties van elke omvang en in alle sectoren – van startups en middelgrote bedrijven tot publiek-private instellingen en ondernemingen – terwijl het de toegang tot AI democratiseert en de energie-efficiëntie verbetert om ’s werelds meest veeleisende workloads aan te drijven.

Door grondige gezamenlijke ontwerpinspanningen op het gebied van rekenkracht, netwerken en opslag, biedt NVIDIA Vera Rubin het meest uitgebreide NVIDIA POD-schaalplatform – een supercomputer waarin meerdere, speciaal voor AI gebouwde racks samenwerken als één enorm, samenhangend systeem.

Praat mee